東海高等学校・中学校「38thサタデープログラム」での発表資料

2月27日(土)開催の東海高等学校・中学校「38thサタデープログラム」で発表予定でしたが、残念ながら中止となりました。せっかくなので、発表予定だった資料を一部編集の上で公開します。ご興味ある方は、ぜひご覧ください。

2月に母校の「38thサタデープログラム」で講演予定です。中高生向けに、日頃の取り組みの楽しさや挑戦を噛み砕いて紹介できればと思っています。

— u++ (@upura0) January 12, 2021

全講座完全事前予約制で、その他の登壇者に河野太郎さん・松丸亮吾さん・平野綾さんら。https://t.co/tp6357rrMy

「Weekly Kaggle News」を横断検索できる仕組みを作った

概要

- 毎週金曜日に更新しているニューズレター「Weekly Kaggle News」を横断検索できる仕組みを作りました

- GitHubのレポジトリに全データを蓄積し、左上の検索ボックスからレポジトリ内を検索できます

- 最新号のデータをAPIで取得し、GitHub Actionsで自動更新するように設定しました

なぜ作った

基本的に自分用です。ニューズレターの発行を重ねるにつれ「この話題、昔どこかの号で取り上げたな」と感じる機会が増えてきました。そのような話題に言及する際、以前の書きぶりを確認する必要が生じます。ただし、現在使っているプラットフォーム「Revue」だと、過去の号を逐一開いて確認しなければなりませんでした。

要件

以上を踏まえて「過去の文字列を検索できること」が最低限の要件になります。また、可能であれば自動的に最新号までを検索対象に含めることが望ましいです。

どうやって作った

Revueが提供しているAPI と GitHub Actions のスケジュール機能 で実現できました。

データの取得に、RevueのAPIを使います。次のように、最新号のデータを取得するAPIを叩きました。データを取得した後は、適当にmdファイルに加工して保存します。

import argparse import requests if __name__ == '__main__': parser = argparse.ArgumentParser() parser.add_argument('--token') args = parser.parse_args() url = 'https://www.getrevue.co/api/v2/issues/latest' headers = {'Authorization': f'Token {args.token}'} req = requests.get(url, headers=headers)

https://github.com/upura/weekly-kaggle-news-archive/blob/master/get_latest_issue.py

あとはこのスクリプトを、定期実行するだけです。毎週土曜日に実行するよう設定しました。

on: schedule: - cron: '0 0 * * SAT'

https://github.com/upura/weekly-kaggle-news-archive/blob/master/.github/workflows/python-package.yml

おわりに

世の中に便利なものが多いおかげで、自分が欲しいものをサクッと作れるありがたい時代だなと感じます。高度な検索を作るならば、Elasticsearchなども検討して良いかもしれません。

2020年をザッと振り返る

年末恒例の振り返り記事です。あっという間に時間が経ちました。

コミュニティ活動

はてなブログは今年も100記事を達成できました。今年初めには、株式会社はてな東京オフィスを訪問する機会も頂きました。*1

印象深いのは、4月6日に公開された「言語処理100本ノック 2020」に取り組んだことです*2。今年は業務で自然言語処理の案件が増えたこともあり、ブログでも関連の話題が増えている印象があります。

「言語処理100本ノック 2020」のソースコード*3や、日本語の自然言語処理に関するスニペット集*4は、GitHubで公開しました。OSS貢献としては、日頃からお世話になっている「Optuna」*5に何度かPRを出せたのが記憶に残っています。

その他、今年は情報発信の場を広げることができました。昨年末に始めたニュースレターを休刊なく継続でき*6、4月にはYouTubeチャンネルも開設しました*7。

昨年末に大半の作業は終わっていましたが、初の著書が刊行されたのも今年でした*8。10月ごろからは、別の共著に着手しています。来年の早い時期に告知できるよう頑張ります。

コンペ

Kaggleのコンペでは、ソロの銀メダル・銅メダルが1枚ずつでした*9。NotebookとDiscussionでのMasterの称号が手の届く位置に来たので、来年あたりに達成できればと考えています。

その他のプラットフォームでは、以下で入賞することができました。

- Nishika, 財務・非財務情報を活用した株主価値予測 2nd (Solo), 2020.*10

- Basketball Behavior Challenge BBC2020 1st (Solo), 2020.*11

- Sansan × atmaCup #6 15th & LT大会 社会人枠最優秀LT賞 (Solo), 2020.*12

- CA × atmaCup 2nd 5th (Team), 2020.*13

英語

会社の研修制度を利用し、6〜12月にわたって英語研修を受けました。毎週1時間×3コマの英会話を受けるなど、英語を喋る機会が大きく増加しました。英作文やプレゼン練習なども含めて日常業務の合間にこなす日々はなかなかに大変でしたが、特にリスニング・スピーキングを中心に外部テストの成績からも成長が感じられた一年でした。

イベント

運営に関わっているイベント「Sports Analyst Meetup」*14を、4回開催できました。急遽のオンライン開催に切り替える中、多くの方々のご協力があってこそ実現したことだと感じています。

発表者の立場では、以下のイベント・番組に登壇する機会を頂きました。関係者の皆様に、改めてお礼申し上げます。

勉強会

- Kaggle Google Quest Q&A Labeling 反省会*15

- 第85回R勉強会@東京*16

- atmaCup#5 振り返り会*17

- Rist主催 Kaggle Workshop #1*18

- Google Cloud「Ask the Expert」*19

- AWS DEV DAY ONLINE JAPAN*20

- SciPy Japan 2020*21

- Sansan × atmaCup #6 LT大会*22

- データサイエンティスト協会シンポジウム*23

- Google Developers ML Summit*24

- CA x atmaCup 2nd 振り返り回*25

- Sports Analyst Meetup #9*26

Podcast

学会

仕事関連は世に出せる情報が必ずしも多くないのですが、以下2本については発表の機会を頂きました。来年も可能な範囲でこういった取り組みを継続していきたいです。

- Shotaro Ishihara, Norihiko Sawa (2020). Age Prediction of News Subscribers Using Machine Learning: Case Study of Hosting Worldwide Data Analysis Competition "Kaggle". Proceedings of Computation + Journalism Symposium 2020. Boston, MA, USA.

- 石原祥太郎 (2020). 新聞記事での共起回数を用いた関連企業の抽出. NLP若手の会 (YANS) 第15回シンポジウム, 2020年9月23日.

表彰

国際ニュースメディア協会が9月に発表した「30 Under 30 Awards」でアジア太平洋部門の最優秀賞を受賞しました*32。これからが大事という賞ですが、まずは過去の取り組みが評価されたことを嬉しく思います。

おわりに

今年はコロナ禍の到来と共に、社会の変化は突然やってくると改めて実感した一年でした。同時に、健康の大切さも身に沁みて感じています。来年も心身の安寧を保ちながら、可能な範囲で視野を広く持って精進していきたいところです。

「Weekly Kaggle News」1周年&購読者数1400人達成

「Kaggle Advent Calendar」 の20日目の記事です。

1年前に始めたニューズレター「Weekly Kaggle News」が1周年を迎えました。日本語で、Kaggleをはじめとするデータ分析コンペティションに関する話題を取り扱っています。週次で毎週金曜日に更新しており、12月18日の号で第53回の配信となりました。

購読者数は、ありがたいことに着実に増加しています。下図の赤は購読者数、青はユニークな開封数です。第53回を配信した数時間後に執筆している関係で、この回の開封数は少なめに出ていると予想されます。メール上で閲覧する以外に、ウェブ上で直接閲覧する手段もあります。最近のウェブ上でのページビューは300〜400程度で、合計すると1000人程度の方がご覧になっているようです。

第26回辺りで大きく伸びているのは、次の記事で取り上げられた影響です。地道に続けてきた20数回があったおかげだとは思いますが、影響力のあるウェブ記事の威力を改めて実感しました。

興味深いのは、第27回以降に購読者数は増加の一途をたどっている一方で、開封数にほとんど変動がない点です。この辺りは、ニューズレターという形態の一種の特性なのかもしれません。下図の黄色が示すニューズレター内のリンクのクリック率も、全ての回を通じて30%辺りを推移しています。

そもそものニューズレターを始めたきっかけは、創刊の記事でも少し触れた通り、近年のニュースメディアの動向でした。近年のSNSの急速な発展に伴う情報過多もあり、改めてニューズレターが持つ価値に注目が集まっています(参考: ニューヨーク・タイムズ「Journalists Are Leaving the Noisy Internet for Your Email Inbox」)。

Weekly Kaggle Newsは無料で公開を続けていますが、この活動を通じてニューズレターの特性や価値を自らの手で感じられているのは、私にとって大きな価値になっています。2020年9月には国際ニュースメディア協会から表彰されましたが、受賞理由の一つには個人での情報発信の活動が掲げられています。いつもご覧いただいている方々に、改めてお礼申し上げます。

最後に、過去にWeekly Kaggle News経由でクリックされたURLのランキングを算出してみました。単純なクリック回数なので、購読者数が増えている直近の回が有利な条件になっています。見落としていた記事があれば、ぜひご覧ください。全ての過去回も公開しています。

1位: 第34回、140クリック

2位: 第33回、131クリック

3位: 第36回、129クリック

4位: 第33回、123クリック

5位: 第37回、116クリック

6位: 第34回、114クリック

Kaggleで学んでハイスコアをたたき出す! Python機械学習&データ分析 | チームカルポ |本 | 通販 | Amazon

7位: 第26回、109クリック

8位: 第31回、105クリック

9位: 第30回、98クリック

書籍『Approaching (Almost) Any Machine Learning Problem』の日本版 Amazon へのリンク(※ 現在はリンク切れ)

10位: 第52回、96クリック

11位: 第40回、95クリック

11位: 第30回、95クリック

PDF『Deep Learning with PyTorch』の無料公開ページ(※ 現在はリンク切れ)

13位: 第51回、94クリック

14位: 第52回、93クリック

15位: 第51回、90クリック

www2.slideshare.net

15位: 第39回、90クリック

「Sports Analyst Meetup #9」をオンラインで開催しました #spoana

「Sports Analyst Meetup #9」*1を、12月13日に開催しました。7、8回目に引き続きのオンライン開催でした。

資料

togetter

発表内容

今回はロングトーク1本、LT6本という構成でした。

ロングトークでは、株式会社ユーフォリアのCEOとエンジニアの両名から、アスリートのコンディションやトレーニングに必要な情報を一括して記録・管理できるデータマネージメントツール『ONE TAP SPORTS』について講演していただきました。ツールとしての機能のみならず、サービスの背景にある思いが垣間見えた素晴らしい発表だと感じました。

LTで扱われた競技はバスケットボール・サッカー・野球と、今回は王道のスポーツが出揃いました。私自身も、以前にブログに書いた「Basketball Behavior Challenge 1st Place Solution」について発表しました。全ての資料がconnpassに挙がっているので、ぜひご覧ください。

- Basketball Behavior Challenge 1位解法(バスケ)

- 八村塁はどんな選手になり得るのか?(バスケ)

- 集団スポーツの軌道予測(2)(バスケ・サッカー)

- 海外のFootball Performance Analyst要件から考えてみた(サッカー)

- 慶大野球部のリーグ戦中にアナリストの僕が取り組んだこと(野球)

- 坂本勇人が通算3,000本安打を打つまで何年かかるかを機械学習でいい感じに出してみる(野球)

アーカイブ

オンライン開催の利点を活かして、発表者の許諾が得られた内容については、YouTubeにアーカイブを掲載していく予定です。

おわりに

今回も多くの方にご参加・ご発表いただき、誠にありがとうございました。多くの方に支えられ、2020年も4度に渡ってspoanaを開催できたことは、運営として嬉しい限りです。来年も、引き続きよろしくお願いいたします。

「#7 CA x atmaCup 2nd 振り返り回」でLTしました

「#7 CA x atmaCup 2nd 振り返り回」*1でLTしました。5位解法とともに、チームマージでの取り組みを具体的に紹介しました。

TF-IDFを用いた「Kaggle流行語大賞2020」

Kaggle Advent Calendar の8日目の記事です。

2018年、2019年に引き続き、今年もTF-IDFを用いた「Kaggle流行語大賞」を算出します。具体的には、2020年に公開されたNotebookのタイトル情報から、頻繁に登場した単語をランキング形式でまとめました。

2018年*1と2019年*2は「探索的データ分析(Explanatory Data Analysis, EDA)」が1位となりました。

それでは今年の結果を見ていきましょう。

集計方法

概ね昨年と同様の方法を採用しました。一連の処理はKaggleのNotebook*3にて公開しています。

データセット

「Meta Kaggle」*4のデータセット「Kernels.csv」を利用しました。公開されているNotebookの公開日・URLなどの情報が格納されています。

NotebookのURLは、ユーザが付けたタイトルに基づいて決まります。下図のように「Simple lightGBM KFold」というタイトルの場合は「simple-lightgbm-kfold」です。

Notebookの絞り込み

一定の評価を受けたNotebookに絞り込むため、次の処理を実施して「Voteを1以上得たNotebook」に集計対象を限定します。

kernels = kernels.query('TotalVotes > 0')

年ごとに分割

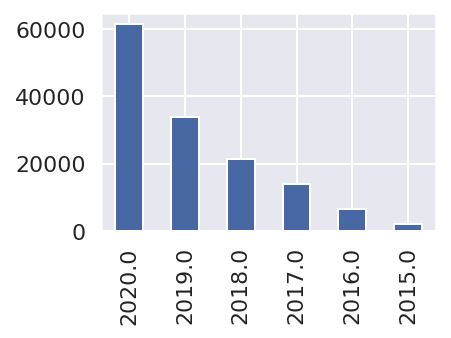

「公開年」別に集計すると、次のようになりました。公開されたNotebookは年々増加しています。

kernels['Date'] = pd.to_datetime(kernels['MadePublicDate']) kernels['Date'].dt.year.value_counts().plot.bar()

TF-IDFを計算

最後に、年を文書、タイトルを文の単位として捉えて「TF-IDF」を計算します。詳細は割愛しますが、多くの年で出現する語(一般的な語)は重要度が下がり、特定の年にしか出現しない単語の重要度は上がるような計算を施すことになります。あらかじめnltk.corpus内の英語のstopwordsを指定して、a, the, ofなどの一般的すぎる単語は取り除いています。

昨年までは筆者の判断でKaggle特有の一般的な単語やコンペのタイトル名に含まれる単語などを除外していましたが、今年は恣意性を排除するために特別な処理は止めました。

from nltk.corpus import stopwords from sklearn.feature_extraction.text import TfidfVectorizer stopWords = stopwords.words("english") vectorizer = TfidfVectorizer(stop_words=stopWords)

結果発表

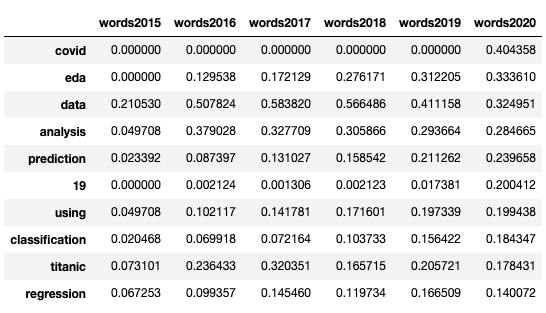

2020年のTF-IDFの値で降順にソートした上位10件を以下に示します。2020年の首位は、突如現れた「covid」でした。「COVID19 Global Forecasting (Week 1) 」コンペ*5や「OpenVaccine: COVID-19 mRNA Vaccine Degradation Prediction」コンペ*6など、COVID-19を題材にしたコンペが複数開催されたのが要因だと考えられます。6位の「19」も、COVID-19から起因するものでしょう。

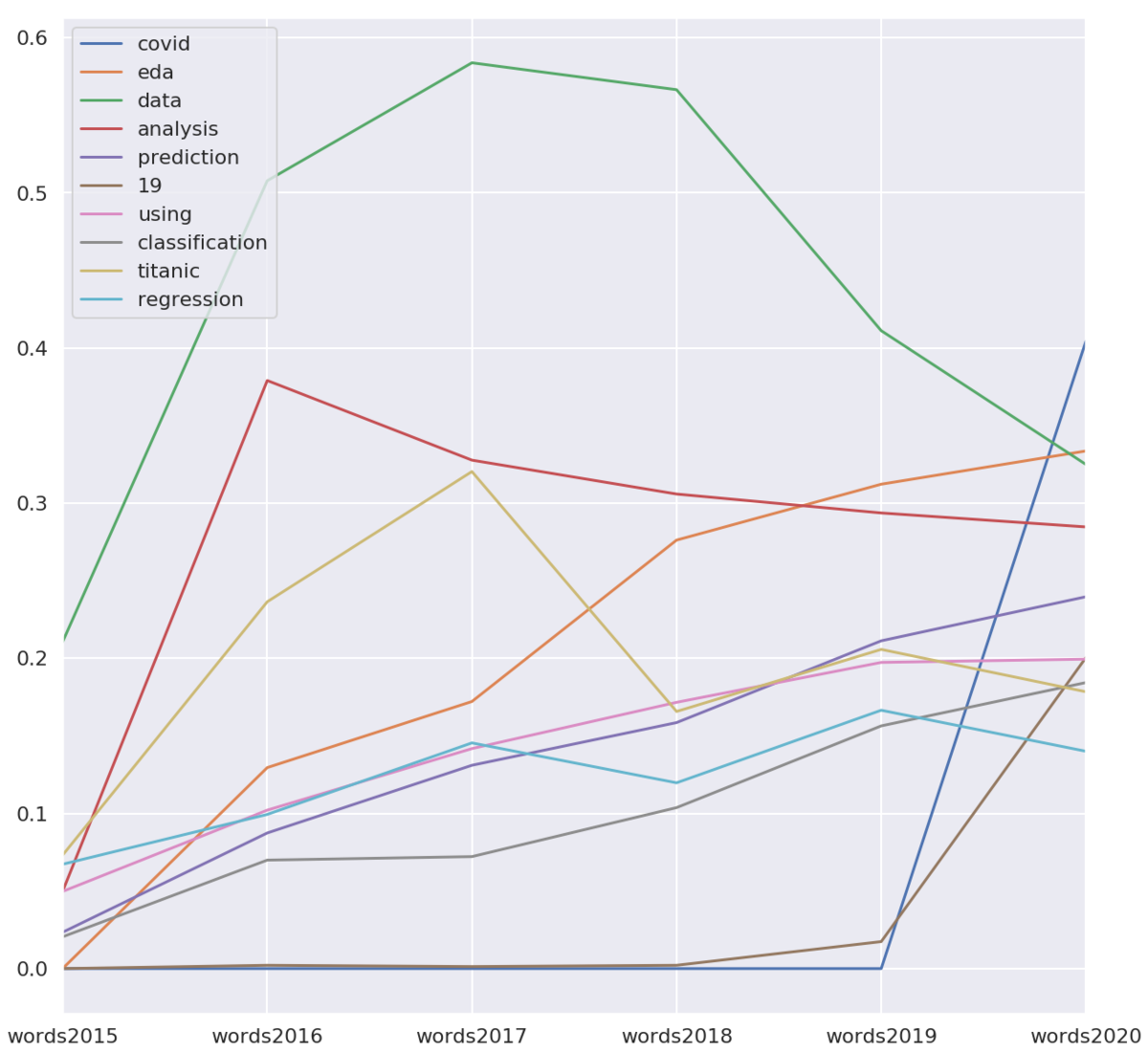

年次の推移は次の通りです。「covid」「19」が2020年に大きくスコアを伸ばしていると分かります。「data」「analysis」を除き2年連続で首位を守ってきた「eda」は、2位になりました。今年は「data」「analysis」を上回りましたが、それ以上にCOVID-19が流行していたという結果でした。

初学者向けコンペの「titanic」は、2015〜2017年に「data」「analysis」を除き1位になっていました。2018年以降は、徐々に順位を落としています。

おわりに

本記事では昨年に引き続き、TF-IDFを用いた「Kaggle流行語大賞」を算出しました。

今年1年も存分に楽しませてもらったKaggleに感謝しつつ、来年もKaggleを楽しんでいきたいです。