複数エンコーダを用いたヤフートピックス見出し候補生成

- 小林健 (ヤフー), 小林隼人 (ヤフー/理研AIP), 村尾一真, 増山毅司 (ヤフー)

- 言語処理学会第24回年次大会(NLP2018)

- http://anlp.jp/proceedings/annual_meeting/2018/pdf_dir/A1-3.pdf

どんなもの?

先行研究と比べてどこがすごい?

技術や手法のキモはどこ?

- 複数エンコーダを利用する「Multimodal Attention モデル」の改良

- 入力

- 記事リード文

- 記事タイトル

- 出力

- トピックス見出し

議論はある?

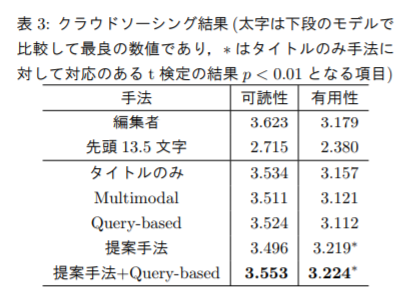

実験結果の細部について議論

次に読むべき論文は?

- Multimodal Attention モデル

- [5] Chiori Hori, Takaaki Hori, Teng-Yok Lee, Ziming Zhang, Bret Harsham, John R. Hershey, Tim K. Marks, and Kazuhiko Sumi. Attention-Based Multimodal Fusion for Video Description. In ICCV, 2017.

- Query-based Attention モデル

- [4] Preksha Nema, Mitesh M. Khapra, Anirban Laha, and Balaraman Ravindran. Diversity driven attention model for query-based abstractive summarization. In ACL, pp. 1063–1072, 2017.